Hacer trampas en la universidad con ChatGPT: cómo evitar la falta de integridad

La inteligencia artificial exige que redefinamos los códigos de comportamiento en las aulas, escribe el divulgador Salman Khan en un libro del que ‘Ideas’ adelanta un extracto

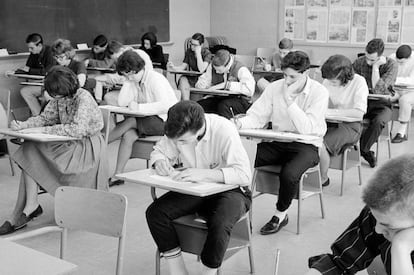

Todas las dinámicas que hacen que la IA sea un elemento complejo y transformador en la educación secundaria se vuelven aún más pronunciadas en la educación superior, donde los alumnos gozan de más independencia. Redactar trabajos finales, por ejemplo, puede formar parte de una experiencia concreta en secundaria, pero en algunos programas universitarios de humanidades, los trabajos tienen casi todo el peso del trabajo que hacen los alumnos a lo largo de la carrera. Si las redacciones hechas con ChatGPT son un problema en el instituto, todavía lo son más en la universidad. Y lo cierto es que este problema no solo afecta a las asignaturas de humanidades, sino a todas en las que la universidad espere de los alumnos que diseñen o generen trabajos inéditos.

Una solución consiste en que las universidades confíen en los alumnos. Muchas instituciones hace ya décadas que se rigen por códigos de honor; bajo estas políticas, los alumnos tienen la libertad de hacer sus trabajos por sí solos, desde redactar trabajos hasta hacer los exámenes en su habitación. En Stanford, por ejemplo, hasta hace poco los profesores no podían vigilar durante los exámenes en las aulas, incluso si querían hacerlo.

Por desgracia, según cuenta la mayoría, los códigos de honor pueden propiciar entornos deshonrosos en los que quienes siguen las reglas se sienten en clara desventaja respecto de los que hacen trampas, muchas veces con descaro. Y lo que es peor es que los códigos de honor obligan a los alumnos a vigilarse entre ellos, aunque las presiones sociales hacen que sea muy poco probable que señalen a sus compañeros. Y cuando lo hacen, a menudo acaba siendo la palabra del uno contra la del otro.

Los alumnos se sienten más cómodos haciendo trampas en la universidad de lo que cabría esperar. Según un estudio llevado a cabo por Inside Higher Ed Student Voice en 2021, el 47% de los encuestados consideraba que era “un poco o muy aceptable” usar “páginas web para encontrar las respuestas a las preguntas de los exámenes o de los trabajos”. Otro artículo de Inside Higher Ed Student Voice recoge una cita de un alumno de último curso de Stanford que afirma que hacer trampas se ha convertido en “parte del tejido de la universidad [...] nadie respeta el código de honor tal como está formulado: ni los alumnos de posgrado, ni el profesorado, ni los alumnos de grado”.

Aunque entiendo por qué los alumnos pueden querer buscar ayuda con sus trabajos, que esté tan generalizada la idea de que es aceptable buscar las respuestas de los exámenes muestra un increíble declive de la integridad académica. Y si a esto le sumamos la súbita generalización de las herramientas de IA, el paisaje empeora.

El caso de Stanford no es una anomalía. Según una encuesta llevada a cabo en 2023 en Middlebury College, casi dos tercios de los alumnos respondieron haber quebrantado el código de honor de la universidad, mientras que el 32% confesaron haber hecho trampas en un examen y el 15% que habían hecho un “uso no autorizado de herramientas de IA/ChatGPT”.

Estas tendencias son la razón de que, en el curso académico de 2023-2024, Stanford revirtiera su política sobre la vigilancia durante los exámenes, de forma que ahora los profesores pueden estar en el aula mientras los alumnos hacen el examen. Según Debra Satz, decana de la Facultad de Humanidades y Ciencia, “los propios alumnos de grado también se han salido del contrato por la falta de responsabilidad. No los culpo [...]. Creo que estamos presenciando el desmoronamiento de una cultura en la que los alumnos que no quieren hacer trampas están en un entorno en que sienten que todos los demás sí las hacen”.

Naturalmente, las trampas ya afectaban a los ejercicios y a los trabajos finales mucho antes de que se inventara ChatGPT. En 2019 —más de tres años antes de que ChatGPT se lanzase públicamente—, The New York Times publicó un reportaje sobre graduados de lugares como Nigeria y Kenia que se ganaban la vida escribiendo los trabajos de estudiantes universitarios de Estados Unidos y otros países ricos. Reciben el trabajo a través de intermediarios en internet, e incluso una búsqueda rápida de “alguien que me haga un trabajo de universidad barato” demuestra lo generalizados que siguen estando estos servicios.

En otras palabras, la IA generativa está poniendo bajo el foco un problema que existe desde hace años. En cuanto a las universidades, o bien han estado sumidas en la ignorancia o bien no han sabido cómo gestionar el problema. Sea como sea, debe resolverse, ya que, de lo contrario, el valor de las carreras universitarias disminuirá y seguirá perpetuándose una situación en que se premia a los jóvenes con problemas de integridad. Sabemos que los universitarios poco íntegros de hoy serán los líderes poco íntegros de las empresas y de los Gobiernos de mañana.

La buena noticia es que hay soluciones. Por ejemplo, si los trabajos de redacción se hacen en clase, podrán recibir la ayuda del profesor y de los demás alumnos. Así, la hora de clase es más activa. Los trabajos o redacciones más largas se pueden hacer en varias horas de clase. Básicamente, se trata de una variación de la clase invertida que hemos estado defendiendo para las asignaturas de matemáticas y ciencias, donde los alumnos hacen lo que solían ser deberes para casa en clase y ven las clases grabadas cuando quieren. Naturalmente, que los alumnos escriban sus trabajos de forma independiente ofrece una serie de beneficios importantes, como el desarrollo de la habilidad de planificarse y de no procrastinar, unas habilidades que podrían considerarse tan útiles como aprender a redactar. Para abordar esta cuestión, algunos profesores han tratado de evitar las trampas pidiendo a los alumnos que muestren más el proceso que han ido siguiendo al hacer el trabajo, desde el esbozo inicial hasta el primer borrador y el trabajo final. Por desgracia, no es difícil externalizar un esbozo o un primer borrador a alguien que está en otro país y te cobra 9 dólares por página, o a ChatGPT.

Tu suscripción se está usando en otro dispositivo

¿Quieres añadir otro usuario a tu suscripción?

Si continúas leyendo en este dispositivo, no se podrá leer en el otro.

FlechaTu suscripción se está usando en otro dispositivo y solo puedes acceder a EL PAÍS desde un dispositivo a la vez.

Si quieres compartir tu cuenta, cambia tu suscripción a la modalidad Premium, así podrás añadir otro usuario. Cada uno accederá con su propia cuenta de email, lo que os permitirá personalizar vuestra experiencia en EL PAÍS.

¿Tienes una suscripción de empresa? Accede aquí para contratar más cuentas.

En el caso de no saber quién está usando tu cuenta, te recomendamos cambiar tu contraseña aquí.

Si decides continuar compartiendo tu cuenta, este mensaje se mostrará en tu dispositivo y en el de la otra persona que está usando tu cuenta de forma indefinida, afectando a tu experiencia de lectura. Puedes consultar aquí los términos y condiciones de la suscripción digital.